到2026年,各种硬件加速器将改变人工智能和边缘计算的格局。这些加速器包括GPU、TPU、FPGA、ASIC、NPU、VPU、DSP、边缘SoC、MCU级加速器、量子加速器、RISC-V人工智能加速器、内存计算、光子加速器、人工智能协处理器和模块化加速器。硬件能够让人工智能在边缘端运行得更快、更好。许多人需要人工智能快速给出答案。边缘人工智能硬件市场每年都在增长,价值数十亿美元。专门的加速器方案和不同的设计能够帮助您应用新的人工智能模型和场景。您可以寻找符合您需求的加速器方案。

关键精华

了解不同的硬件加速器,例如 GPU、TPU 和 FPGA。每种加速器都针对特定的 AI 任务提供帮助,并带来特定的优势。

选择最适合您人工智能工作需求的加速器。考虑速度、功耗和灵活性。这将有助于您获得最佳结果。

持续学习量子计算和RISC-V加速器等新技术。这些新工具能够让人工智能运行得更好、更快速。

看看硬件和运行成本是多少。重要的是要权衡前期投入和后期节省的成本。这有助于你更好地利用人工智能。

想想看,选择加速器后,扩展有多么容易。某些类型的加速器允许您根据人工智能需求的变化添加或更改组件。

AI硬件加速器概述

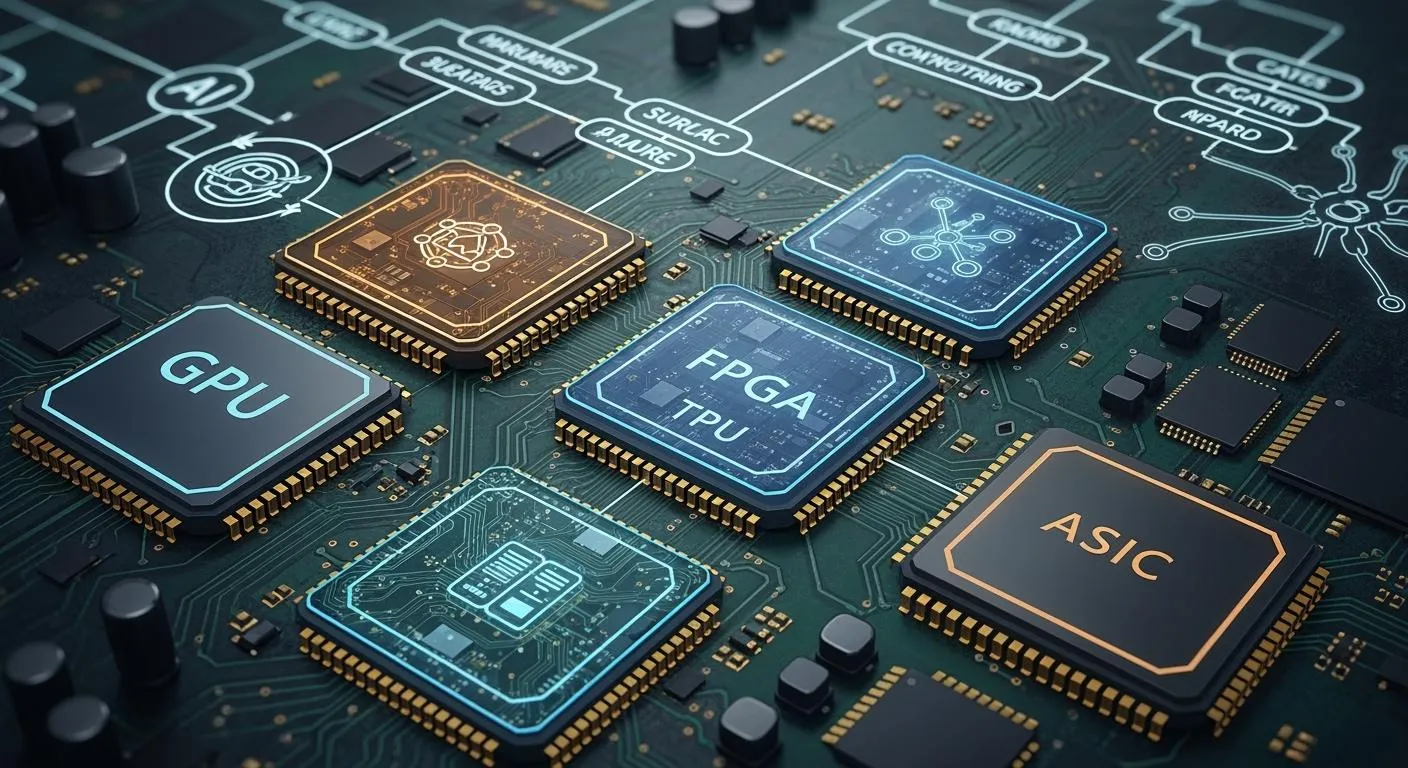

图形处理器

GPU 可以帮助您同时执行多个 AI 任务。它们非常适合并行计算。您可以在智能摄像头和自动驾驶汽车等边缘设备中看到它们的身影。GPU 可以加快数据处理速度,从而有助于快速做出决策。它们还支持 5G 网络,因此数据传输速度更快。

常见用途:

在自动驾驶汽车中寻找物体

在工厂里,在机器发生故障之前进行维修。

在安全系统中发现异常情况

2026 年的领先车型:

NVIDIA Rubin平台

AMD Helios平台

NVIDIA B200 和 H200 Tensor Core GPU 性能卓越,能够快速处理大量数据。它们值得信赖,可用于强大的 AI 计算。

热塑性聚氨酯

TPU 是专为人工智能任务而设计的芯片,可用于深度学习和机器学习。TPU 采用脉动阵列设计,使其能够同时处理大量数学运算。它们与 TensorFlow 配合使用效果最佳。与 GPU 或 CPU 相比,TPU 能帮助您更快地训练和运行 AI 模型。

主要特点:

节省能源

专为特定工作而设计

与 TensorFlow 兼容性良好

边缘应用场景:

智能工厂

守护着地方

独立工作的机器人

2026 年顶级模特:

用于边缘人工智能的推理TPU

边缘 TPU 可为设备端 AI TPU 提供快速而强大的 AI 性能提升,尤其适用于边缘数据。

FPGA的

FPGA 是一种可更换的硬件加速器。您可以对其进行重新编程,以适应新的 AI 模型。这使得它们非常适合频繁更换工作。FPGA 的功耗比 CPU 低。您可以重复使用它们,因此它们的使用寿命更长。

主要用途:

立即处理传感器数据

智能AI控制

安全硬件

2026 年的热门车型:

AMD Versal 和 Alveo 系列

英特尔 Agilex 系列

莱迪思半导体的低功耗FPGA可帮助您无需更换芯片即可满足新的AI需求。它兼具灵活性和节能性。

ASIC的

专用集成电路(ASIC)是专为特定任务而设计的芯片。它们在人工智能领域以极高的速度和极低的功耗而著称。ASIC 既适用于人工智能训练,也适用于推理。与 GPU 相比,它们的性能提升 50%,功耗降低 30%。

优点:

每瓦性能都非常出色。

降低运行成本

人工智能快速给出答案

2026 年的顶尖公司:

AMD

华为

Graphcore

Nvidia公司

字母

当您多次运行同一个 AI 模型时,苹果 ASIC 芯片是最佳选择。

神经网络处理器

神经网络处理器(NPU)是用于神经网络的硬件加速器,常见于手机和边缘人工智能设备中。NPU 能以极低的延迟提供快速的人工智能结果,同时功耗更低,从而延长电池续航时间。

常见应用:

人脸识别

语音任务

寻找物体

2026 年的领先车型:

搭载 SPOT 优化 NPU 的 Atomiq SoC

Arm Ethos-U85 NPU 可帮助您在边缘快速运行 AI 模型并节省能源。

虚拟处理器

视觉处理单元(VPU)是人工智能在处理图像和视频方面的应用。它们被广泛应用于相机、无人机和智能家居设备中,用于追踪物体和识别手势等任务。

主要特点:

耗电量低

快速视频检查

用例:

智能手表系统

增强现实虚拟物理单元 (VPU) 可让您为设备添加人工智能视觉功能并节省能源。

DSP的

DSP是数字信号处理器,用于音频和视频处理。它能辅助语音指令、音频处理和电话通话。

常见用途:

语音助手

智能音箱音质更佳

手机 DSP 中的视频处理功能可为您提供快速、智能的信号 AI 处理能力。

边缘SoC

边缘SoC将CPU、GPU、NPU等组件集成在单个芯片上,为您提供在边缘进行AI所需的一切。边缘SoC有助于您快速做出决策、减少数据使用量并保护隐私。

优点:

重要工作的快速解答

更好的隐私和安全

即使网络状况不佳也能正常工作

节省电池电量

用例:

自动驾驶汽车

增强现实

智能家居边缘SoC让AI能够在数据获取点附近运行,从而使设备更智能、更快速。

MCU级加速器

MCU级加速器将人工智能带入小型设备。它们可用于可穿戴设备、传感器和智能小工具。这些加速器使模型在简单的硬件上也能更好地运行。

主要特点:

一次性处理多个数学任务

智能内存使用

让主CPU休息并节省电量

2026 年顶级模特:

英飞凌 PSoC Edge E84

意法半导体 (STMicroelectronics) 的 STM32N6 MCU 级加速器可帮助您将 AI 集成到微型设备中,并保持其高效运行。

量子加速器

量子加速器利用量子计算进行人工智能运算。它们可以用于诸如发现新药或评估金融风险等大型任务。量子人工智能的运行速度比传统计算机更快。

主要用途:

医疗保健(研发新药)

资金(检查风险)

改善供应链

2026 年的新兴模式:

IBM量子计算机

AMD 和 IBM 的混合量子-经典系统 量子加速器将改变你解决复杂人工智能问题的方式。

RISC-V AI 加速器

RISC-V AI 加速器采用开放灵活的设计,您可以根据 AI 任务的需求进行定制。这些加速器支持多种计算类型和特殊功能。

主要特点:

开源且易于更改

可处理多核处理器

可与不同硬件良好兼容

2026 年顶级模特:

X160 Gen 2、X180 Gen 2(物联网和远边缘)

X280 Gen 2、X390 Gen 2、XM Gen 2(现代 AI 工作)RISC-V AI 加速器让您可以控制您的芯片并使其满足您的需求。

内存计算

内存计算加速器直接在数据存储位置进行计算。使用它们可以节省数据传输的时间和能源。这可以加快人工智能任务的运行速度并节省电力。

用例:

数据中心的人工智能答案

边缘设备拥有大量数据,内存计算可以帮助您更好地使用大型 AI 模型。

光子加速器

光子加速器利用光来处理数据。它速度更快,能耗更低。这些加速器非常适合需要大量数据和快速响应的人工智能任务。

应用环境:

数据中心人工智能工作

快速边缘分析光子加速器为您提供了一种让 AI 更好地工作的新方法。

人工智能协处理器

AI协处理器是辅助主芯片运行的额外芯片。它们用于执行AI任务,从而提升系统运行速度。AI协处理器可以处理语音和图像等任务。

产品优势

更好的系统速度

耗电量更少

用例:

手机

笔记本电脑的 AI 协处理器可帮助您添加 AI 功能,而不会降低主芯片的运行速度。

模块化加速器

模块化加速器允许您根据需要添加或更换 AI 硬件。您可以更换模块以使用新的 AI 模型或获得更强大的性能。这为您提供了灵活性,并确保您的系统始终保持最新状态。

优点:

容易升级

适合新工作

用例:

边缘网关

工厂自动化模块化加速器可帮助您跟上快速变化的人工智能技术。

提示: 选择硬件加速器时,请考虑您的 AI 应用需求、所需数据以及设备的使用场景。合适的芯片可以让您的 AI 运行更快、更智能,并节省能源。

加速器对比

性能

您肯定希望边缘设备运行速度快。GPU 和 TPU 为大型 AI 模型提供了强大的处理能力。ASIC 和 NPU 也能快速完成图像识别等 AI 任务。FPGA 允许您根据特定任务调整其性能。量子加速器可以显著提升 AI 的速度,但目前并非所有设备都配备了量子加速器。模块化加速器则允许您在需要更强大的性能时添加新组件,从而获得更佳的性能。

电源效率

对于边缘AI而言,节能至关重要。您需要延长电池续航时间并保持设备低温运行。一些硬件,例如Google Edge TPU和Intel Movidius Myriad X,功耗很低,但AI性能依然出色。SiMa.ai MLSoC的功耗低于5瓦,却能提供超过50 TOPS的运算速度。Hailo-8性能优异,功耗仅为3瓦左右。NVIDIA Jetson AGX Orin性能强劲,但功耗更高,最高可达60瓦。您可以在下表中查看这些加速器的性能对比:

加速器类型 | 上装 | 功耗(W) | 效率类别 |

|---|---|---|---|

SiMa.ai MLSoC | 50年 | <5 | 高性能 |

海洛 8 | 26 | 2.5-3 | 平衡的表现 |

高通RB5 | 15 | 5-15 | 平衡的表现 |

瑞芯微RK3588 | 6 | 8-15 | 低电量 |

英特尔 Movidius Myriad X | 4 | 5 | 低电量 |

谷歌边缘 TPU | 4 | 2 | 低电量 |

恩智浦 i.MX 8M Plus | 2.3 | 3-8 | 低电量 |

NVIDIA Jetson AGX Orin | 275 | 10-60 | 高性能 |

阿克塞拉·梅蒂斯 | 214 | 20-40 | 高性能 |

提示:选择适合人工智能任务的芯片,可以节省电量并获得良好的效果。

部署方案

人工智能加速器的应用场景非常广泛。边缘SoC和MCU级加速器适用于小型传感器和可穿戴设备。GPU、NPU和VPU则应用于智能相机、汽车和手机。数据中心则使用ASIC、FPGA和光子加速器来处理大型人工智能任务。模块化加速器让您可以根据人工智能模型的变化轻松升级硬件。

可扩展性

您希望您的 AI 系统能够随着需求的增长而扩展。模块化加速器和 FPGA 允许您添加更多组件或更换组件以适应新的 AI 模型。GPU 和 ASIC 非常适合批量处理大型 AI 任务。边缘 SoC 和 RISC-V AI 加速器则为小型和大型部署提供了多种选择。

成本

选择人工智能硬件时,成本是一个重要的考量因素。MCU 和 VPU 成本较低,适用于简单的 AI 任务。ASIC 和量子加速器成本较高,但能为特殊任务提供顶级性能。模块化加速器允许您仅升级所需组件,从而帮助您节省成本。在选择之前,您应该综合考虑成本、性能和功耗。

选择加速器

应用需求

首先,思考一下你的AI应用需要做什么。有些任务需要快速响应,例如自动驾驶汽车。智能摄像头也需要快速出结果。而另一些任务,例如医疗保健或工厂,则需要处理大量数据。如果你想使用多种AI模型,就需要具备灵活性。下表展示了不同类型芯片在AI计算方面的性能对比:

因素 | 图形处理器 | 神经网络处理器 | FPGA的 | ASIC的 |

|---|---|---|---|---|

灵活性 | 灵活性高,支持多种型号 | 适度的灵活性,根据任务需要而定 | 可重构但复杂 | 灵活性最差,重新设计成本最高 |

迭代时间 | 由于与工具兼容,速度很快 | 对于神经网络来说速度相对较快 | 由于重新配置,耗时更长 | 速度最慢,需要重新设计才能更新 |

性能 | 资源利用率高,性能优异 | 性能优异但需要微调 | 适用于特定任务,需要手动调整。 | 每瓦性能最佳,但需要大量设计工作。 |

GPU 能够让你快速修改代码,而且非常灵活。NPU 和 FPGA 则适合处理特殊的 AI 任务。ASIC 速度极快,但修改起来比较困难。

可扩展性

考虑一下你的AI系统未来可能的发展方向。如果以后想增加AI处理能力,可以使用模块化加速器或FPGA。云平台能帮助你快速扩展,但你需要为实际使用的资源付费。如果你的AI任务保持不变,那么使用本地部署的芯片可以节省成本。选择符合你未来规划的硬件。

部署环境

决定人工智能的运行位置。边缘设备,例如传感器和可穿戴设备,需要低功耗的小型芯片。数据中心则使用大型人工智能芯片来处理繁重的任务。边缘部署方案初期成本可能较高,但后期可以节省开支。云解决方案虽然灵活,但需要按月付费。根据您的数据和需求,选择最适合您人工智能的部署位置。

性能与功率

你想要强大的AI,但同时也想节省电量。NPU和VPU非常适合边缘AI,因为它们能耗更低。GPU和ASIC能提供更强大的AI处理能力,但能耗也更高。你应该在AI任务的速度和电池续航时间之间找到平衡。如果需要长续航时间,请选择功耗更低的芯片。

成本因素

既要考虑硬件价格,也要考虑运行成本。企业需要在购买新芯片和支付电力及散热费用之间取得平衡。边缘人工智能初期成本可能较高,但后期可以节省资金。云端人工智能虽然灵活,但需要按月付费。在选择人工智能硬件之前,务必仔细核算所有成本。

提示:始终根据实际需求来调整人工智能的性能。这有助于提高速度、节省能源并控制成本。

你需要为你的AI任务选择合适的AI硬件加速器。每种芯片都提供不同的AI运行和数据处理方式。你可以使用AI来处理数据、训练AI模型并提升计算能力。一些加速器可以帮助你节省能源,而另一些则能为大型AI任务提供更强大的计算能力。从边缘设备到数据中心,AI的应用无处不在。新型芯片不断改变着AI的使用方式。保持对AI硬件的好奇心,你才能为你的AI未来做出更明智的选择。

常见问题

什么是硬件加速器?

硬件加速器是一种芯片,可以帮助你的设备更快地执行人工智能任务。它可以加快图像识别和语音命令等操作的速度,还可以用于数据分析。

如何为你的项目选择合适的加速器?

想想你的AI任务是什么,需要多少算力,以及你的预算。如果你希望能够轻松更改设置,可以选择GPU或FPGA。如果需要节省功耗,可以使用NPU或VPU。务必选择与你的任务相匹配的芯片。

以后可以升级人工智能硬件吗?

没错!模块化加速器允许你添加新部件或更换旧部件。无需购买全新的设备,即可保持系统性能的更新。

所有边缘设备都需要同一种类型的加速器吗?

不。不同的设备使用不同的加速器。例如:

设备类型 | 通用加速器 |

|---|---|

智能相机 | VPU、NPU |

耐磨 | MCU级 |

工厂机器人 | FPGA、ASIC |

您选择最适合您设备的加速器。