Gli acceleratori hardware vengono utilizzati per gestire enormi quantità di dati. Consentono di eseguire modelli di intelligenza artificiale complessi molto velocemente. Questi dispositivi semplificano e potenziano i lavori di intelligenza artificiale e apprendimento automatico. Negli ultimi anni, sono stati sviluppati molti nuovi tipi di hardware per l'intelligenza artificiale. Le aziende ora realizzano piattaforme specifiche per diverse applicazioni di intelligenza artificiale:

Microsoft sta realizzando un chip di intelligenza artificiale per il suo visore HoloLens.

Google utilizza una Tensor Processing Unit per l'intelligenza artificiale nel cloud.

Amazon sta realizzando un chip di intelligenza artificiale per Alexa.

Apple realizza un processore AI per Siri e FaceID.

Tesla costruisce un processore di intelligenza artificiale per le auto a guida autonoma.

Man mano che il software di intelligenza artificiale diventa più intelligente, anche l'hardware cambia per stare al passo.

Punti chiave

Gli acceleratori hardware velocizzano le attività di intelligenza artificiale. Aiutano a gestire grandi quantità di dati rapidamente.

Esistono diversi acceleratori, come GPU e ASIC. Ognuno di essi è progettato per svolgere compiti specifici nell'ambito dell'intelligenza artificiale. Scegli quello più adatto alle tue esigenze.

Gli acceleratori hardware possono consumare meno energia e costare meno. Questo fa sì che i tuoi progetti di intelligenza artificiale funzionino meglio.

Il calcolo parallelo suddivide i compiti più complessi in compiti più piccoli. Questi piccoli compiti vengono eseguiti contemporaneamente per migliorare le prestazioni dell'intelligenza artificiale.

In futuro, l'hardware di intelligenza artificiale sarà dotato di chip speciali e di edge computing, che renderanno le cose ancora più veloci ed efficienti.

Acceleratori hardware nell'intelligenza artificiale

Velocità ed efficienza

Hai bisogno di strumenti veloci per lavorare con molti dati in AIGli acceleratori hardware aiutano a elaborare i dati molto più velocemente. Questi dispositivi sono più veloci delle normali CPU. Possono essere utilizzati per l'apprendimento automatico e AI i lavori vanno più veloci.

Alcuni tipi principali di ai Gli acceleratori sono:

Unità di elaborazione grafica (GPU)

Unità di elaborazione tensore (TPU)

Unità di elaborazione centrale (CPU)

Array di gate programmabili sul campo (FPGA)

Le GPU sono speciali perché hanno molti piccoli core. Puoi usarle per fare molti calcoli matematici contemporaneamente. Questo è ottimo per ai Lavori come il riconoscimento delle immagini o compiti linguistici. Gli ASIC personalizzati sono realizzati per specifici lavori. Offrono prestazioni elevate e consentono di risparmiare energia. Questi acceleratori aiutano ad addestrare i modelli più velocemente e a consumare meno energia.

Suggerimento: Se utilizzi acceleratori hardware, puoi completare l'addestramento del tuo ai modelli in ore, non in giorni.

I benchmark mostrano la velocità di questi acceleratori. Ad esempio, le GPU possono raggiungere circa 15,700 GFLOPS. Le TPU possono eseguire fino a 275,000 operazioni INT8 al secondo. Strumenti come il benchmark MLPerf Training consentono di confrontare la velocità di diversi ai Gli acceleratori funzionano. Puoi vedere quale è il migliore per te ai posti di lavoro.

Abilitare l'apprendimento profondo

I modelli di apprendimento profondo possono avere miliardi di parametri. Hai bisogno di una solida ai Acceleratori per addestrare questi modelli. Acceleratori hardware come FPGA, GPU e ASIC lo rendono possibile. Aiutano a utilizzare meno memoria e a lavorare più velocemente. Ciò significa che è possibile addestrare modelli più grandi senza problemi di memoria.

Ecco come diversi acceleratori aiutano con l'apprendimento profondo:

Acceleratore | A CHE COSA SERVE |

|---|---|

GPU | Utilizzano numerosi processori per reti neurali complesse. Grazie a questo, è possibile addestrare i modelli di deep learning più velocemente. |

ASIC | Sono fatti per uno scopo speciale ai lavori. Si ottiene una formazione più rapida e si consuma meno energia. |

FPGA | Puoi modificarne il design in base alle tue esigenze, renderli più efficienti e adatti a gestire modelli di grandi dimensioni. |

Si ottengono anche sistemi di memoria ad alta larghezza di banda. Questi sistemi impediscono ai dati di bloccarsi e mantengono il tuo ai modelli funzionano bene. Quando si utilizza più di una GPU, è possibile addestrare modelli ancora più grandi. Tecnologie come InfiniBand e NVLink aiutano a spostare rapidamente i dati tra i dispositivi. Questo rende il tuo ai lavori più grandi ed efficienti.

È possibile utilizzare metodi basati sulla localizzazione dei dati per ottenere i dati più rapidamente.

È possibile ridurre la quantità di comunicazione durante l'allenamento.

È possibile migliorare le unità aritmetiche per ottenere una maggiore velocità.

Con questi strumenti, puoi addestrare modelli di deep learning per applicazioni avanzate ai lavori come il riconoscimento vocale, le auto a guida autonoma e la diagnosi medica. Gli acceleratori hardware aiutano a ottenere maggiore precisione e velocità in ai.

Tipi di acceleratori di intelligenza artificiale

È possibile scegliere tra numerosi acceleratori di intelligenza artificiale. Ognuno è progettato per un compito specifico. Alcuni sono più adatti a specifiche attività di intelligenza artificiale. I principali tipi sono GPU, NPU, FPGA e ASIC. Questi strumenti aiutano a eseguire l'apprendimento automatico in modo più rapido ed efficace.

Acceleratore hardware | Funzionalità principali | Vantaggi | Limiti |

|---|---|---|---|

GPU | Utilizzano molti core per lavorare insieme. | Ottimo per lavori di matematica e per lavorare velocemente sui dati. | Per alcuni lavori non sono adatti quanto gli ASIC. |

NPU | Progettato per reti neurali. | Ottimo per l'apprendimento approfondito e per risparmiare energia. | Non sono flessibili come gli FPGA. |

FPGA | Puoi cambiare il loro funzionamento. | È possibile adattarli a lavori speciali e ottenere risultati rapidi. | Più difficile da configurare e programmare. |

ASIC | Realizzato per un solo scopo. | Molto veloce e consuma poca energia per svolgere quel lavoro. | Non puoi usarli per altri lavori. |

GPU

Le GPU sono ampiamente utilizzate per i lavori di intelligenza artificiale. Possono svolgere più attività contemporaneamente. Questo aiuta a gestire grandi quantità di dati in modo rapido. Le GPU sono ottime per il deep learning e per trovare rapidamente le risposte. È possibile addestrare i modelli più velocemente e svolgere attività come il riconoscimento delle immagini. Le GPU sono utili anche per la matematica utilizzata nel machine learning.

Le GPU elaborano più dati contemporaneamente.

Ottieni un addestramento più rapido e più potenza per l'intelligenza artificiale.

NPU

Le NPU sono progettate per le reti neurali. Le si trovano in molti prodotti di intelligenza artificiale. Le NPU sono veloci e risparmiano energia per il deep learning. Sono adatte a applicazioni che richiedono risposte rapide, come le auto a guida autonoma o i robot. Le NPU supportano i dati dei sensori, il parlato e le immagini.

Le NPU migliorano il funzionamento dei sistemi di intelligenza artificiale.

Forniscono risposte rapide e lavori nel settore dei media.

FPGA

Gli FPGA consentono di modificarne il funzionamento in base alle proprie esigenze. È possibile configurarli per nuovi lavori dopo averli acquistati. Gli FPGA sono ideali per lavori che richiedono risultati rapidi e alta potenza. È possibile utilizzarli per progetti di intelligenza artificiale speciali in cui è necessario il controllo.

Gli FPGA consentono di progettare hardware per l'intelligenza artificiale.

Puoi cambiarli per nuovi lavori quando ne hai bisogno.

ASIC

Gli ASIC sono progettati per un solo tipo di applicazione di intelligenza artificiale. Offrono la massima velocità e risparmiano energia. Gli ASIC sono ideali per applicazioni che non cambiano, come la telefonia o i data center. Sono veloci e consumano poca energia, ma non possono essere utilizzati per altri scopi.

Gli ASIC sono realizzati per applicazioni di intelligenza artificiale specifiche.

Ottieni risposte rapide e risparmi energia.

Suggerimento: quando scegli un acceleratore di intelligenza artificiale, pensa ai tuoi lavori nel settore e a quanto devi cambiare le cose. Ogni tipologia è adatta a lavori diversi.

Ottimizzazione del carico di lavoro dell'intelligenza artificiale

Formazione vs inferenza

Ci sono due fasi principali nell'intelligenza artificiale. La prima è l'addestramento. L'addestramento richiede molta potenza di calcolo. Si affrontano molti problemi matematici ripetutamente. Potenti acceleratori di intelligenza artificiale aiutano in questi compiti difficili. La seconda fase è l'inferenza. L'inferenza significa che l'intelligenza artificiale esamina nuovi dati e fa delle scelte. Questa fase non richiede molto hardware. È possibile utilizzare un solo acceleratore o persino una CPU.

Nota: velocizzare l'inferenza può far risparmiare molto denaro. Molti strumenti di intelligenza artificiale, come i controlli antifrode e i suggerimenti, necessitano di un'inferenza rapida e intelligente.

L'hardware da scegliere dipende dal lavoro che devi svolgere. Ecco alcuni esempi:

Scenario | Hardware di formazione | Hardware di inferenza |

|---|---|---|

Motore di previsione delle vendite | CPU | CPU |

Modello di classificazione delle immagini | GPU | CPU o GPU se necessario |

Il modo in cui si esegue l'inferenza può cambiare. Dipende dalle dimensioni del modello, da dove lo si utilizza e dalla velocità con cui si desiderano le risposte. Potrebbe essere necessario configurare le cose, ottimizzarle, implementarle, lavorare con modelli di grandi dimensioni o utilizzarle ai margini. Creare un buon sistema di inferenza richiede spesso esperti. Non si tratta solo di nuovo hardware.

Tecniche di calcolo parallelo

È possibile migliorare il funzionamento dell'intelligenza artificiale utilizzando il calcolo parallelo. Ciò significa suddividere i compiti più grandi in compiti più piccoli, che vengono eseguiti contemporaneamente. Gli acceleratori di intelligenza artificiale utilizzano diversi metodi per farlo:

L'elaborazione parallela suddivide i lavori su più CPU o GPU. Questo rende l'intelligenza artificiale più veloce ed efficace.

Il parallelismo dei dati scompone i dati in parti. Ogni acceleratore lavora su una sola parte. Si mettono insieme tutte le risposte.

Il parallelismo del modello suddivide il modello di intelligenza artificiale. Acceleratori diversi lavorano contemporaneamente su parti diverse.

Questi metodi aiutano le app di intelligenza artificiale a funzionare più velocemente. Ad esempio, GPU e NPU utilizzano l'elaborazione parallela per supportare il deep learning e risparmiare energia. Si ottengono risultati migliori e si può lavorare su progetti di intelligenza artificiale più complessi senza rallentamenti.

Confronto degli acceleratori

Prestazioni ed efficienza

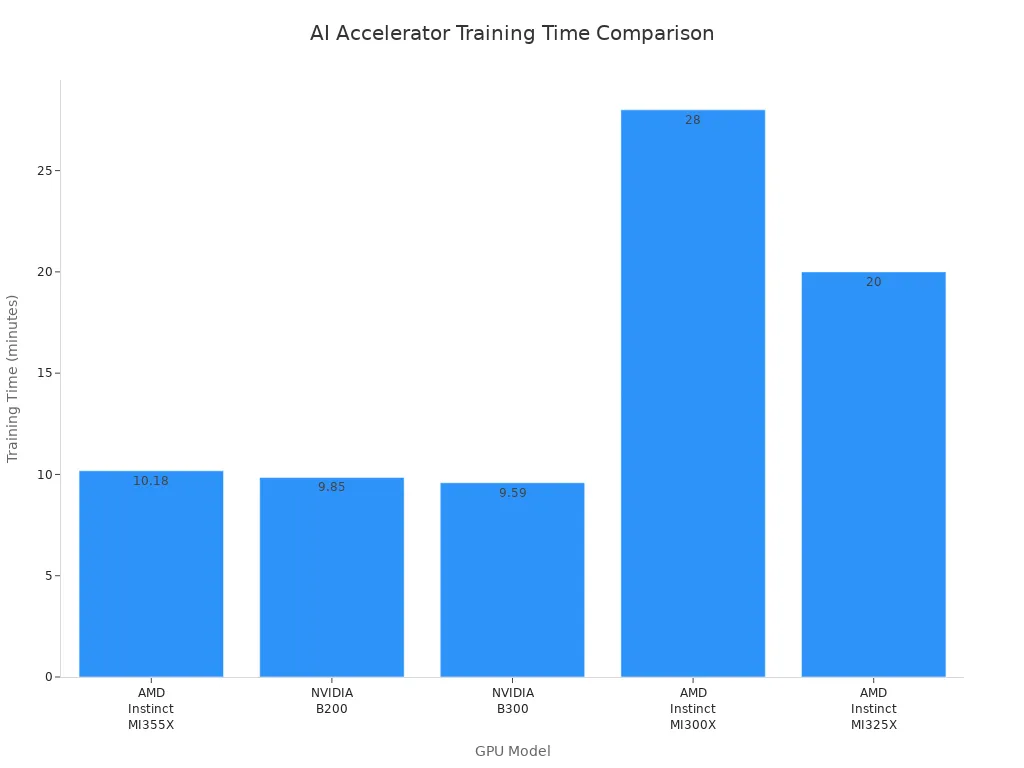

Tu vuoi il tuo progetti di intelligenza artificiale per funzionare velocemente e consumano meno energia. Confrontando hardware diversi, si osserva la velocità con cui completano le attività e la quantità di energia consumata. Alcuni acceleratori possono addestrare modelli di intelligenza artificiale molto più velocemente di altri. Ad esempio, gli ultimi risultati dei benchmark mostrano che l'NVIDIA B300 può completare l'addestramento in soli 9.59 minuti. L'AMD Instinct MI355X è fino a 2.8 volte più veloce dei modelli precedenti. È possibile vedere come questi dispositivi si confrontano nella tabella sottostante.

Modello GPU | Tempo di allenamento (minuti) | Guadagno delle prestazioni |

|---|---|---|

AMD Istinto MI355X | 10.18 | Fino a 2.8 volte più veloce |

Nvidia B200 | 9.85 | N/A |

Nvidia B300 | 9.59 | N/A |

AMD Istinto MI300X | 28 | N/A |

AMD Istinto MI325X | ~ 20 | N/A |

Puoi usare questi numeri per scegliere l'hardware di intelligenza artificiale più adatto alle tue esigenze. Un training più rapido significa che puoi provare più idee e ottenere risultati più rapidamente. Prestazioni elevate ti aiutano anche a risparmiare energia e denaro. Scegliendo l'hardware giusto, aumenti sia la velocità che l'efficienza.

Scenari di distribuzione

È possibile utilizzare l'intelligenza artificiale in molti contesti, come sul cloud o all'edge. Ogni contesto presenta vantaggi e limiti. Se si utilizza l'intelligenza artificiale all'edge, si eliminano i ritardi di rete. Si mantengono inoltre i dati privati e si riducono i costi. Ad esempio, l'intelligenza artificiale all'edge può ridurre i tempi di attesa di rete da 50 a 200 millisecondi. Riduce anche i costi dei dati fino all'80%. Nel cloud, si potrebbero riscontrare ritardi maggiori e un maggiore utilizzo dei dati.

Ecco una tabella per aiutarti a confrontare l'intelligenza artificiale edge e cloud:

Aspetto | Vantaggi dell'intelligenza artificiale Edge | Limitazioni dell'intelligenza artificiale nel cloud |

|---|---|---|

Latenza | Elimina la latenza di andata e ritorno della rete di 50-200 ms | Elevata latenza dovuta alla trasmissione dei dati |

Privacy dei dati | Elabora i dati sensibili localmente | Richiede la trasmissione dei dati a server esterni |

Ottimizzazione della larghezza di banda | Riduce la larghezza di banda elaborando i dati localmente | Elevato utilizzo della larghezza di banda per la trasmissione dei dati |

Riduzione dei costi | Riduzione del 60-80% dei costi di trasmissione dati | Costi operativi più elevati dovuti alla larghezza di banda |

Dovresti pensare a dove vuoi che funzioni la tua intelligenza artificiale. Se hai bisogno di risposte rapide e privacy, l'intelligenza artificiale edge è la soluzione migliore. Se hai bisogno di molta potenza per progetti di grandi dimensioni, l'intelligenza artificiale cloud potrebbe essere la scelta migliore. La scelta giusta dipende dal tuo progetto e dai tuoi obiettivi.

Sfide e tendenze

Problemi di integrazione

Quando si utilizzano acceleratori hardware nell'intelligenza artificiale, si possono riscontrare dei problemi. È necessario assicurarsi che hardware e software funzionino bene insieme. Se non funzionano correttamente, i modelli di intelligenza artificiale potrebbero essere lenti. È inoltre necessario monitorare la quantità di energia e memoria utilizzata. Questo è molto importante con i modelli di intelligenza artificiale di grandi dimensioni. A volte, è necessario modificare la configurazione per nuovi metodi di intelligenza artificiale. La tabella seguente elenca alcuni problemi comuni:

La sfida | Descrizione |

|---|---|

Ottieni la massima velocità abbinando hardware e software. | |

L'efficienza delle risorse | Utilizzo di meno energia e memoria per i grandi modelli di intelligenza artificiale. |

Adattabilità | Assicurarti che il tuo sistema possa adattarsi alle nuove idee dell'intelligenza artificiale. |

È possibile utilizzare nuovi software per risolvere questi problemi. Ad esempio, SNAX consente di collegare facilmente diversi acceleratori. Offre un livello semplice, così puoi concentrarti sul tuo lavoro di intelligenza artificiale. SNAX-MLIR ti aiuta a utilizzare meglio la memoria e i dati. Questo rende il tuo sistema di intelligenza artificiale più veloce.

Suggerimento: strumenti come SNAX ti consentono di aggiungere nuovi acceleratori e di modificare la configurazione man mano che la tua intelligenza artificiale cresce.

Il futuro dell'hardware AI

Grandi cambiamenti sono in arrivo per l'hardware di intelligenza artificiale. Le aziende ora realizzano chip di intelligenza artificiale specifici per specifici compiti. Questi chip aiutano l'intelligenza artificiale a funzionare più velocemente e a consumare meno energia. Vedrete anche più sistemi che utilizzano processori diversi contemporaneamente, come GPU, FPGA e ASIC. Questo è chiamato elaborazione eterogenea. Aiuta a ottenere i migliori risultati per ogni compito di intelligenza artificiale.

Ecco alcune tendenze per il futuro:

Vengono utilizzati sempre più chip di intelligenza artificiale personalizzati, come NPU e TPU.

L'edge computing consente di elaborare i dati vicino al punto di origine, riducendo i ritardi e mantenendo la riservatezza dei dati.

L'informatica neuromorfica sfrutta progetti simili a quelli del cervello per risparmiare energia e migliorare l'intelligenza artificiale.

L'informatica quantistica potrebbe risolvere problemi molto complessi, ma ha ancora molti problemi da risolvere.

Gli esperti ritengono che il mercato dell'hardware per l'intelligenza artificiale crescerà notevolmente. Nel 2024, il mercato varrà 16.55 miliardi di dollari. Entro il 2029, potrebbe raggiungere i 52.76 miliardi di dollari. Ciò significa che crescerà di circa il 26% ogni anno.

Nota: man mano che l'hardware di intelligenza artificiale migliora, avrai più modi per rendere i tuoi progetti di intelligenza artificiale più veloci e potenti.

Gli acceleratori hardware offrono molti vantaggi nell'intelligenza artificiale. Questi strumenti aiutano a lavorare più velocemente. Permettono di prendere decisioni immediate. Inoltre, consentono di risparmiare denaro. Date un'occhiata alla tabella seguente per una rapida panoramica:

Benefici | Descrizione |

|---|---|

Prestazioni migliorate | Rende l'intelligenza artificiale più veloce e funziona meglio |

Energy Efficiency | Utilizza meno energia per i lavori di intelligenza artificiale |

Scalabilità | Può crescere man mano che la tua intelligenza artificiale diventa più grande |

Scegli l'acceleratore migliore per il tuo lavoro di intelligenza artificiale. Nuovi design di chip e nuovi modi per risparmiare energia cambieranno il funzionamento dell'intelligenza artificiale in futuro.

FAQ

Cos'è un acceleratore hardware nell'intelligenza artificiale?

Un acceleratore hardware è un chip o un dispositivo speciale. Viene utilizzato per velocizzare le attività di intelligenza artificiale. Aiuta il computer a gestire big data e modelli complessi senza rallentamenti.

Perché sono necessari diversi tipi di acceleratori di intelligenza artificiale?

Sono necessari acceleratori diversi perché ogni compito di intelligenza artificiale è unico. Alcuni sono più adatti all'addestramento, altri alla rapidità. Scegli quello giusto per ottenere la massima velocità e risparmiare energia.

È possibile utilizzare gli acceleratori hardware a casa?

Sì, puoi usare alcuni acceleratori a casa. Molti laptop e desktop sono dotati di GPU. Queste ti aiutano a eseguire programmi di intelligenza artificiale per l'apprendimento, i giochi o piccoli progetti.

In che modo gli acceleratori hardware risparmiano energia?

Gli acceleratori hardware completano rapidamente le attività di intelligenza artificiale. Consumano meno energia rispetto alle CPU tradizionali. Questo aiuta a risparmiare energia e a ridurre la bolletta elettrica.

Qual è il futuro dell'hardware AI?

Vedrete sempre più chip personalizzati per l'intelligenza artificiale. Questi renderanno i vostri dispositivi più intelligenti e veloci. Nuovi design, come i chip neuromorfici e quantistici, cambieranno il modo in cui utilizzate l'intelligenza artificiale.