Du ser mange slags hardwareacceleratorer, der vil ændre AI og edge computing i 2026. Disse inkluderer GPU'er, TPU'er, FPGA'er, ASIC'er, NPU'er, VPU'er, DSP'er, edge SoC'er, MCU-klasse acceleratorer, kvanteacceleratorer, RISC-V AI-acceleratorer, in-memory computing, fotoniske acceleratorer, AI-coprocessorer og modulære acceleratorer. Hardware gør AI hurtigere og bedre ved kanten. Mange mennesker har brug for hurtige svar fra AI. Markedet for edge AI-hardware bliver større hvert år. Det er milliarder af dollars værd. Specielle acceleratorprogrammer og forskellige designs hjælper dig med at bruge nye AI-modeller og -situationer. Du kan søge efter acceleratorprogrammer, der passer til det, du har brug for.

Nøgleforsøg

Lær om forskellige hardwareacceleratorer som GPU'er, TPU'er og FPGA'er. Hver især hjælper med særlige AI-opgaver og giver bestemte fordele.

Vælg den bedste accelerator til dine AI-arbejdsbehov. Tænk på hastighed, hvor meget strøm den bruger, og hvor fleksibel den er. Dette hjælper dig med at få de bedste resultater.

Bliv ved med at lære om nye ting som kvante- og RISC-V-acceleratorer. Disse nye værktøjer kan få AI til at fungere bedre og hurtigere.

Se på, hvor meget hardwaren og driften vil koste. Det er vigtigt at finde en balance mellem, hvad du betaler i starten, og hvad du sparer senere. Dette hjælper dig med at bruge AI godt.

Tænk over, hvor nemt det er at vokse, når du vælger acceleratorer. Nogle typer giver dig mulighed for at tilføje eller ændre dele, efterhånden som dine AI-behov ændrer sig.

Oversigt over AI-hardwareacceleratorer

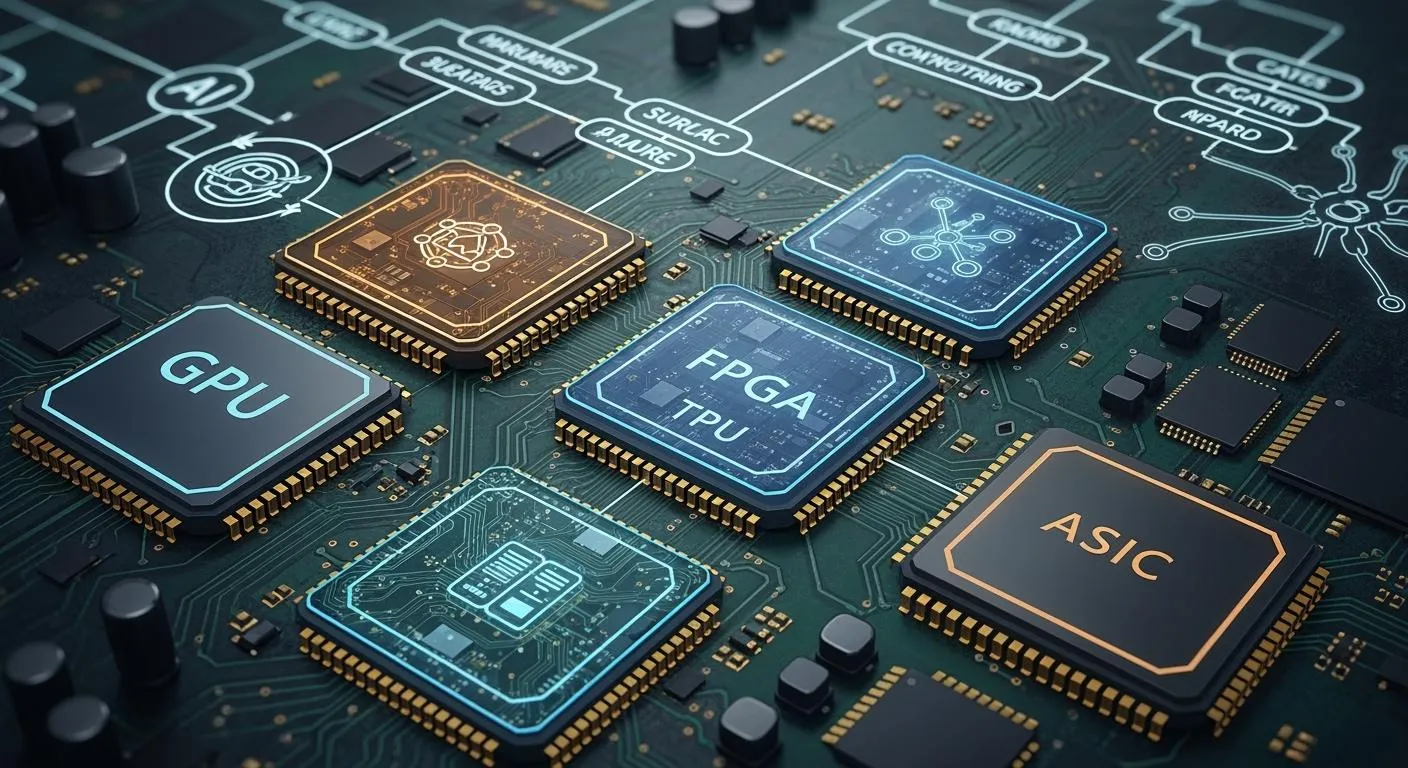

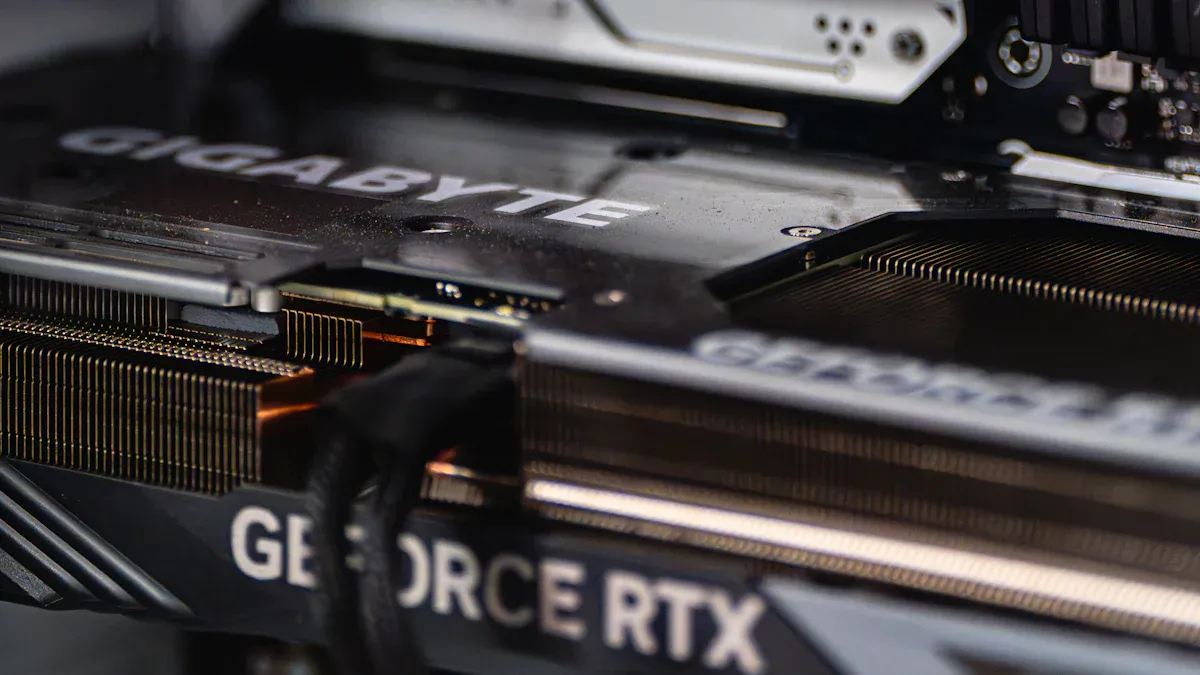

GPU'er

GPU'er hjælper dig med at udføre mange AI-opgaver på én gang. De er gode til parallel databehandling. Du ser dem i edge-enheder som smartkameraer og selvkørende biler. GPU'er gør databehandling hurtig. Dette hjælper med hurtige valg. De fungerer også med 5G, så data bevæger sig hurtigere.

Almindelige anvendelser:

Finde genstande i selvkørende biler

Reparation af maskiner før de går i stykker på fabrikker

Opdagelse af mærkelige ting i sikkerhedssystemer

Førende modeller i 2026:

NVIDIA Rubin-platformen

AMD Helios-platform

NVIDIA B200 og H200 Tensor Core GPU'er GPU'er er fantastiske, fordi de håndterer masser af data hurtigt. Du kan stole på dem til stærk AI-databehandling.

TPU'er

TPU'er er specielle chips lavet til AI-opgaver. Du bruger dem til deep learning og maskinlæring. TPU'er har et systolisk array-design. Dette giver dem mulighed for at løse mange matematiske problemer på én gang. De fungerer bedst med TensorFlow. TPU'er hjælper dig med at træne og køre AI-modeller hurtigere end GPU'er eller CPU'er.

Nøglefunktioner:

Sparer energi

Lavet til bestemte job

Fungerer godt med TensorFlow

Kantbrugssager:

Smarte fabrikker

Overvågning af steder

Robotter, der arbejder alene

Topmodeller i 2026:

Inferens-TPU'er til kant-AI

Edge TPU'er til AI på enheder giver dig hurtige og store AI-boosts, især til edge-data.

FPGA'er

FPGA'er er hardwareacceleratorer, som du kan ændre. Du kan omprogrammere dem til nye AI-modeller. Dette gør dem gode til at skifte job. FPGA'er bruger mindre strøm end CPU'er. Du kan bruge dem igen, så de holder længere.

Hovedanvendelser:

Håndtering af sensordata med det samme

Smart AI-styring

Sikkerhedshardware

Populære modeller i 2026:

AMD Versal- og Alveo-serien

Intel Agilex-serien

Lattice Semiconductor FPGA'er med lavt strømforbrug FPGA'er hjælper dig med at tilpasse dig nye AI-behov uden nye chips. Du får både fleksibilitet og strømbesparelser.

ASICs

ASIC'er er chips, der kun er lavet til én opgave. Du bruger dem til tophastighed og lavt strømforbrug i AI. ASIC'er er gode til både AI-træning og inferens. De fungerer 50 % bedre og bruger 30 % mindre strøm end GPU'er.

fordele:

Fantastisk ydeevne for hver watt

Lavere driftsomkostninger

Hurtige svar fra AI

Topvirksomheder i 2026:

AMD

Huawei

Graphcore

Nvidia

Alfabet

Apple ASIC'er er bedst, når man kører den samme AI-model mange gange.

NPU'er

NPU'er er hardwareacceleratorer til neurale netværk. Du finder dem i telefoner og edge AI-enheder. NPU'er giver dig hurtige AI-resultater med lav forsinkelse. De bruger mindre strøm, så batterierne holder længere.

Almindelige applikationer:

Ansigtsgenkendelse

Taleopgaver

Finde objekter

Førende modeller i 2026:

Atomiq SoC med SPOT-optimeret NPU

Arm Ethos-U85 NPU NPU'er hjælper dig med at køre AI-modeller hurtigt og spare energi ved kanten.

VPU'er

VPU'er er visionsbehandlingsenheder. De bruges til AI-opgaver med billeder og video. VPU'er findes i kameraer, droner og smart home-enheder. De kan ting som at spore objekter og læse bevægelser.

Nøglefunktioner:

Bruger lidt strøm

Hurtige videotjek

Brug sager:

Smartwatch-systemer

Augmented reality VPU'er giver dig mulighed for at tilføje AI-vision til enheder og spare energi.

DSP'er

DSP'er er digitale signalprocessorer. Du bruger dem til lyd- og videoopgaver. DSP'er hjælper med stemmekommandoer, lydarbejde og telefonopkald.

Almindelige anvendelser:

Stemmehjælpere

Bedre lyd i smarthøjttalere

Videoarbejde i telefoner med DSP'er giver dig hurtig og smart AI til signaler.

Edge SoC'er

Edge SoC'er samler CPU'er, GPU'er, NPU'er og mere på én chip. Du får alt, hvad du behøver til AI i edge-miljøet. Edge SoC'er hjælper dig med at træffe hurtige valg, bruge mindre data og holde tingene private.

fordele:

Hurtige svar på vigtige opgaver

Bedre privatliv og sikkerhed

Fungerer fint selv med dårligt internet

Sparer batteristrøm

Brug sager:

Selvkørende biler

Augmented reality

Smart homes Edge SoC'er giver dig mulighed for at køre AI tæt på, hvor du modtager data. Dette gør enheder smartere og hurtigere.

MCU-klasse acceleratorer

MCU-klasse acceleratorer bringer kunstig intelligens til små enheder. De bruges i wearables, sensorer og smarte gadgets. Disse acceleratorer får modeller til at fungere bedre på simpel hardware.

Nøglefunktioner:

Håndterer mange matematikopgaver på én gang

Smart hukommelsesbrug

Lader hoved-CPU'en hvile og sparer strøm

Topmodeller i 2026:

Infineon PSoC Edge E84

STMicroelectronics STM32N6 MCU-klasse acceleratorer hjælper dig med at integrere AI i bittesmå enheder og holde dem effektive.

Kvanteacceleratorer

Kvanteacceleratorer bruger kvanteberegning til kunstig intelligens. De bruges til store opgaver som at finde nye lægemidler eller kontrollere pengerisici. Kvante-AI fungerer hurtigere end almindelige computere.

Hovedanvendelser:

Sundhedspleje (at finde nye lægemidler)

Penge (kontrol af risici)

Gør forsyningskæder bedre

Nye modeller i 2026:

IBM kvantecomputere

AMD og IBM hybride kvante-klassiske systemer Kvanteacceleratorer vil ændre, hvordan man løser vanskelige AI-problemer.

RISC-V AI-acceleratorer

RISC-V AI-acceleratorer bruger åbne og fleksible designs. Du kan ændre dem til dine AI-job. Disse acceleratorer understøtter mange typer databehandling og specialfunktioner.

Nøglefunktioner:

Open source og nem at ændre

Håndterer mange kerner

Fungerer godt med forskelligt hardware

Topmodeller i 2026:

X160 Gen 2, X180 Gen 2 (IoT og fjernkant)

X280 Gen 2, X390 Gen 2, XM Gen 2 (moderne AI-job) RISC-V AI-acceleratorer giver dig mulighed for at kontrollere dine chips og tilpasse dem til dine behov.

Computing i hukommelse

In-memory computing acceleratorer arbejder med data, hvor de er lagret. Du bruger dem til at spare tid og energi på at flytte data. Dette gør AI-job hurtigere og sparer strøm.

Brug sager:

AI-svar i datacentre

Edge-enheder med masser af data. In-memory computing hjælper dig med at bruge store AI-modeller bedre.

Fotoniske acceleratorer

Fotoniske acceleratorer bruger lys til at behandle data. Du får højere hastigheder og bruger mindre strøm. Disse acceleratorer er gode til AI-opgaver, der kræver mange data og hurtige svar.

Applikationer:

AI-arbejde i datacenteret

Fotoniske acceleratorer med hurtig kantanalyse giver dig en ny måde at få AI til at fungere bedre.

AI-medprocessorer

AI-coprocessorer er ekstra chips, der hjælper din primære chip. Du bruger dem til at udføre AI-opgaver og gøre dit system hurtigere. AI-coprocessorer håndterer ting som tale og billeder.

Fordele:

Bedre systemhastighed

Bruger mindre strøm

Brug sager:

Telefoner

AI-coprocessorer i bærbare computere hjælper dig med at tilføje AI-funktioner uden at gøre din primære chip langsommere.

Modulære acceleratorer

Modulære acceleratorer giver dig mulighed for at tilføje eller ændre AI-hardware efter behov. Du kan udskifte moduler for at bruge nye AI-modeller eller få mere kraft. Dette giver dig fleksibilitet og holder dit system opdateret.

fordele:

Nem at opgradere

Passer til nye job

Brug sager:

Kantportene

Fabriksautomatisering Modulære acceleratorer hjælper dig med at holde trit med hurtige ændringer i AI.

Tip: Når du vælger hardwareacceleratorer, skal du tænke over dit AI-job, de data, du har brug for, og hvor du bruger dine enheder. Den rigtige chip kan gøre din AI hurtigere, smartere og spare energi.

Acceleratorsammenligning

Ydeevne

Du ønsker, at dine edge-enheder skal arbejde hurtigt. GPU'er og TPU'er giver masser af kraft til store AI-modeller. ASIC'er og NPU'er gør også AI-opgaver som billedgenkendelse hurtige. FPGA'er giver dig mulighed for at ændre, hvor godt de fungerer til specielle opgaver. Kvanteacceleratorer kunne gøre AI meget hurtigere, men du ser dem ikke i alle enheder endnu. Modulære acceleratorer hjælper dig med at få bedre ydeevne ved at tilføje nye dele, når du har brug for mere kraft.

Strømeffektivitet

Det er vigtigt at spare strøm for Edge AI. Batterierne skal holde længe, og enhederne skal holde sig kølige. Nogle hardware-enheder, som f.eks. Google Edge TPU og Intel Movidius Myriad X, bruger lidt strøm, men kører stadig AI-effektivt. SiMa.ai MLSoC giver over 50 TOPS med mindre end 5 watt. Hailo-8 fungerer godt og bruger kun omkring 3 watt. NVIDIA Jetson AGX Orin er stærk, men bruger mere strøm, op til 60 watt. Du kan se, hvordan disse acceleratorer klarer sig i tabellen nedenfor:

Accelerator type | TOPPE | Strømforbrug (W) | Effektivitetskategori |

|---|---|---|---|

SiMa.ai MLSoC | 50 + | <5 | High Performance |

Hailo-8 | 26 | 2.5-3 | Afbalanceret ydelse |

Qualcomm RB5 | 15 | 5-15 | Afbalanceret ydelse |

Rockchip RK3588 | 6 | 8-15 | Lav strøm |

Intel Movidius Myriad X | 4 | 5 | Lav strøm |

Google Edge TPU | 4 | 2 | Lav strøm |

NXP i.MX 8M Plus | 2.3 | 3-8 | Lav strøm |

NVIDIA Jetson AGX Orin | 275 | 10-60 | High Performance |

Axelera Metis | 214 | 20-40 | High Performance |

Tip: Vælg den rigtige chip til dit AI-job for at spare strøm og få gode resultater.

Implementeringsscenarier

Du kan bruge AI-acceleratorer mange steder. Edge SoC'er og MCU-klasse acceleratorer passer i små sensorer og wearables. GPU'er, NPU'er og VPU'er findes i smarte kameraer, biler og telefoner. Datacentre bruger ASIC'er, FPGA'er og fotoniske acceleratorer til store AI-opgaver. Modulære acceleratorer giver dig mulighed for at opgradere din hardware, når dine AI-modeller ændrer sig.

Skalerbarhed

Du ønsker, at dit AI-system skal vokse, efterhånden som du har brug for flere. Modulære acceleratorer og FPGA'er giver dig mulighed for at tilføje flere dele eller ændre dem til nye AI-modeller. GPU'er og ASIC'er fungerer godt til store AI-opgaver i grupper. Edge SoC'er og RISC-V AI-acceleratorer giver dig valgmuligheder for både små og store opsætninger.

Pris

Prisen er vigtig, når man vælger AI-hardware. MCU'er og VPU'er koster mindre og fungerer godt til simple AI-opgaver. ASIC'er og kvanteacceleratorer koster mere, men giver topydelse til specielle opgaver. Modulære acceleratorer hjælper dig med at spare penge ved kun at lade dig opgradere det, du har brug for. Du bør tænke over omkostninger, ydeevne og strømforbrug, før du vælger.

Valg af acceleratorer

Ansøgningsbehov

Tænk først over, hvad din AI-app skal kunne. Nogle opgaver kræver hurtige svar, som f.eks. selvkørende biler. Smarte kameraer kræver også hurtige resultater. Andre opgaver, som f.eks. sundhedsvæsenet eller fabrikker, bruger mange data. Hvis du vil bruge mange AI-modeller, har du brug for fleksibilitet. Tabellen nedenfor viser, hvordan forskellige siliciumtyper sammenlignes til AI-beregning:

faktor | GPU'er | NPU'er | FPGA'er | ASICs |

|---|---|---|---|---|

Fleksibilitet | Høj fleksibilitet, understøtter forskellige modeller | Moderat fleksibilitet, skræddersyet til opgaver | Rekonfigurerbar, men kompleks | Mindst fleksibel, dyr at redesigne |

Iterationstid | Hurtig takket være kompatibilitet med værktøjer | Relativt hurtigt for neurale netværk | Længere på grund af omkonfiguration | Langsomst, kræver redesign til opdateringer |

Ydeevne | Høj ydeevne med ressourceudnyttelse | Høj ydeevne, men trænger til finjustering | Ekstraordinært til specifikke opgaver, manuel indstilling kræves | Bedste ydeevne pr. watt, betydeligt designarbejde nødvendigt |

GPU'er giver dig mulighed for at ændre ting hurtigt og er fleksible. NPU'er og FPGA'er er gode til specielle AI-opgaver. ASIC'er er meget hurtige, men svære at ændre.

Skalerbarhed

Tænk over, hvordan dit AI-system kan vokse. Hvis du vil tilføje mere AI-kraft senere, kan du bruge modulære acceleratorer eller FPGA'er. Cloudplatforme hjælper dig med at vokse hurtigt, men du betaler for det, du bruger. On-premise silicium kan spare penge, hvis dine AI-job forbliver de samme. Vælg hardware, der passer til dine fremtidsplaner.

Implementeringsmiljø

Beslut, hvor din AI skal køre. Edge-enheder, som sensorer og wearables, har brug for små chips, der bruger lidt strøm. Datacentre bruger store AI-chips til tunge opgaver. Edge-opsætninger kan koste mere i starten, men spare penge senere. Cloud-løsninger er fleksible, men du betaler hver måned. Vælg det bedste sted til din AI baseret på dine data og behov.

Ydeevne vs. Kraft

Du vil have stærk AI, men du vil også spare strøm. NPU'er og VPU'er er gode til edge-AI, fordi de bruger mindre energi. GPU'er og ASIC'er giver dig mere AI-kraft, men bruger mere energi. Du bør finde en balance mellem hastighed og batterilevetid til dit AI-job. Hvis du har brug for lang batterilevetid, skal du vælge chips, der bruger mindre strøm.

Omkostningsfaktorer

Se på både prisen på hardwaren og omkostningerne ved at drive den. Virksomheder balancerer køb af nye chips med at betale for strøm og køling. Edge AI kan koste mere i starten, men sparer penge senere. Cloud AI er fleksibel, men du betaler hver måned. Tjek alle omkostninger, før du vælger din AI-hardware.

Tip: Tilpas altid din AI-kraft til det, du virkelig har brug for. Dette hjælper dig med at opnå god hastighed, spare strøm og kontrollere omkostninger.

Du skal finde den rigtige AI-hardwareaccelerator til dit AI-job. Hver type silicium giver dig forskellige måder at køre AI og håndtere data på. Du kan bruge AI til at behandle data, træne AI-modeller og øge computerkraften. Nogle acceleratorer hjælper dig med at spare energi. Andre giver dig mere computerkraft til store AI-opgaver. Du ser AI mange steder, fra edge-enheder til datacentre. Nyt silicium ændrer hele tiden, hvordan du bruger AI. Bliv nysgerrig på AI-hardware. Du kan træffe bedre valg for din AI-fremtid.

Ofte stillede spørgsmål

Hvad er en hardwareaccelerator?

En hardwareaccelerator er en chip, der hjælper din enhed med at udføre AI-opgaver hurtigere. Den gør ting som billedgenkendelse og stemmekommandoer hurtigere. Du bruger den også til dataanalyse.

Hvordan vælger du den rigtige accelerator til dit projekt?

Tænk over dit AI-job, hvor meget strøm du har brug for, og dit budget. Hvis du vil ændre tingene nemt, så vælg en GPU eller FPGA. Hvis du har brug for at spare strøm, så brug en NPU eller VPU. Vælg altid en chip, der passer til dit job.

Kan du opgradere din AI-hardware senere?

Ja! Modulære acceleratorer giver dig mulighed for at tilføje nye dele eller udskifte gamle. Du kan holde dit system opdateret uden at købe en helt ny enhed.

Har alle edge-enheder brug for den samme type accelerator?

Nej. Forskellige enheder bruger forskellige acceleratorer. For eksempel:

Device Type | Fælles accelerator |

|---|---|

Smart kamera | VPU, NPU |

Bærbar | MCU-klasse |

Fabriksrobot | FPGA, ASIC |

Du vælger den accelerator, der fungerer bedst til din enhed.