Du bruger hardwareacceleratorer til at håndtere enorme mængder data. De hjælper med at køre komplekse AI-modeller meget hurtigt. Disse enheder gør AI- og maskinlæringsopgaver lettere og stærkere. I de seneste par år er der kommet mange nye typer AI-hardware. Virksomheder laver nu specielle platforme til forskellige AI-opgaver:

Microsoft laver en AI-chip til sit HoloLens-headset.

Google bruger en Tensor Processing Unit til kunstig intelligens i skyen.

Amazon laver en AI-chip til Alexa.

Apple laver en AI-processor til Siri og FaceID.

Tesla bygger en AI-processor til selvkørende biler.

I takt med at AI-software bliver smartere, ændrer hardwaren sig også for at følge med.

Nøgleforsøg

Hardwareacceleratorer gør AI-opgaver hurtigere. De hjælper dig med at håndtere store mængder data hurtigt.

Der findes forskellige acceleratorer som GPU'er og ASIC'er. Hver enkelt er lavet til bestemte AI-opgaver. Vælg den, der passer til dine behov.

Hardwareacceleratorer kan bruge mindre energi og koste færre penge. Dette gør dine AI-projekter bedre fungerende.

Parallel beregning opdeler store opgaver i mindre. Disse små opgaver kører samtidig for at forbedre AI-ydeevnen.

I fremtiden vil AI-hardware have særlige chips og edge computing. Disse vil gøre tingene endnu hurtigere og mere effektive.

Hardwareacceleratorer i AI

Hastighed og effektivitet

Du har brug for hurtige værktøjer til at arbejde med masser af data i AIHardwareacceleratorer hjælper dig med at behandle data meget hurtigere. Disse enheder er hurtigere end normale CPU'er. Du kan bruge dem til at lave maskinlæring og AI jobbet går hurtigere.

Nogle hovedtyper af ai acceleratorer er:

Graphics Processing Units (GPU'er)

Tensor Processing Units (TPU'er)

Central Processing Units (CPU'er)

Field-Programmable Gate Arrays (FPGA'er)

GPU'er er specielle, fordi de har mange små kerner. Du kan bruge dem til at lave en masse matematik på én gang. Dette er fantastisk til ai job som billedgenkendelse eller sprogopgaver. Brugerdefinerede ASIC'er er lavet til bestemte job. De giver dig stærk ydeevne og sparer energi. Disse acceleratorer hjælper dig med at træne modeller hurtigere og bruge mindre strøm.

Tip: Hvis du bruger hardwareacceleratorer, kan du afslutte træningen af dine ai modeller i timer, ikke dage.

Benchmarks viser, hvor hurtige disse acceleratorer er. For eksempel kan GPU'er nå omkring 15,700 GFLOPS. TPU'er kan udføre op til 275,000 INT8-operationer hvert sekund. Værktøjer som MLPerf Training-benchmarken lader dig sammenligne, hvor godt forskellige ai acceleratorer virker. Du kan se, hvilken der er bedst for dig ai beskæftigelse.

Muliggørelse af dyb læring

Deep learning-modeller kan have milliarder af parametre. Du har brug for stærke ai Acceleratorer til at træne disse modeller. Hardwareacceleratorer som FPGA'er, GPU'er og ASIC'er gør dette muligt. De hjælper dig med at bruge mindre hukommelse og arbejde hurtigere. Det betyder, at du kan træne større modeller uden hukommelsesproblemer.

Sådan hjælper forskellige acceleratorer med deep learning:

Accelerator | Hvordan det hjælper |

|---|---|

GPU'er | De bruger mange processorer til komplekse neurale netværk. På grund af dette kan man træne deep learning-modeller hurtigere. |

ASICs | De er lavet til særlige formål ai job. Du får hurtigere træning og bruger mindre strøm. |

FPGA'er | Du kan ændre deres design efter dine behov. Du kan gøre dem mere effektive og håndtere store modeller. |

Du får også hukommelsessystemer med høj båndbredde. Disse systemer forhindrer data i at sidde fast og holder dine ai modeller kører godt. Når du bruger mere end én GPU, kan du træne endnu større modeller. Teknologier som InfiniBand og NVLink hjælper dig med at flytte data hurtigt mellem enheder. Dette gør din ai større og mere effektive opgaver.

Du kan bruge datalokalitetsbevidste metoder til at få data hurtigere.

Du kan reducere mængden af kommunikation under træning.

Du kan forbedre aritmetiske enheder for at opnå mere hastighed.

Med disse værktøjer kan du træne deep learning-modeller til avancerede ai job som talegenkendelse, selvkørende biler og medicinsk diagnose. Hardwareacceleratorer hjælper dig med at opnå bedre nøjagtighed og hastighed i ai.

Typer af AI-acceleratorer

Du kan vælge mellem mange AI-acceleratorer. Hver enkelt er lavet til et særligt job. Nogle fungerer bedre til bestemte AI-opgaver. Hovedtyperne er GPU'er, NPU'er, FPGA'er og ASIC'er. Disse værktøjer hjælper dig med at udføre maskinlæring hurtigere og bedre.

Hardware Accelerator | Nøglefunktioner | Fordele | Begrænsninger |

|---|---|---|---|

GPU'er | De bruger mange kerner til at arbejde sammen. | Fantastisk til matematikopgaver og hurtigt dataarbejde. | Ikke så god til nogle job som ASIC'er. |

NPU'er | Bygget til neurale netværk. | Meget god til dybdegående læring og sparer energi. | Ikke så fleksibel som FPGA'er. |

FPGA'er | Du kan ændre, hvordan de fungerer. | Du kan få dem til at passe til specielle opgaver og få hurtige resultater. | Sværere at sætte op og programmere. |

ASICs | Lavet til kun ét job. | Meget hurtig og bruger lidt strøm til det arbejde. | Du kan ikke bruge dem til andre opgaver. |

GPU'er

GPU'er bruges meget til AI-opgaver. De kan gøre mange ting på samme tid. Dette hjælper dig med at håndtere mange data hurtigt. GPU'er er fantastiske til deep learning og hurtige svar. Du kan træne modeller hurtigere og udføre ting som billedgenkendelse. GPU'er hjælper også med matematik, der bruges i maskinlæring.

GPU'er arbejder på mange dataelementer på én gang.

Du får hurtigere træning og mere kraft til AI'en.

NPU'er

NPU'er er lavet til neurale netværk. Man ser dem i mange AI-produkter. NPU'er er hurtige og sparer energi til deep learning. De er gode til ting, der kræver hurtige svar, såsom selvkørende biler eller robotter. NPU'er hjælper med sensordata, tale og billeder.

NPU'er får AI-systemer til at fungere bedre.

De hjælper med hurtige svar og medieopgaver.

FPGA'er

FPGA'er giver dig mulighed for at ændre, hvordan de fungerer, så de passer til dine behov. Du kan konfigurere dem til nye job, efter du har købt dem. FPGA'er er gode til job, der kræver hurtige resultater og høj ydeevne. Du kan bruge dem til særlige AI-job, hvor du ønsker kontrol.

FPGA'er giver dig mulighed for at designe hardware til din AI.

Du kan udskifte dem til nye job efter behov.

ASICs

ASIC'er er lavet til én slags AI-job. De giver dig tophastighed og sparer energi. ASIC'er er bedst til job, der ikke ændrer sig, såsom tale- eller datacenterarbejde. De er hurtige og bruger lidt strøm, men du kan ikke bruge dem til andre ting.

ASIC'er er lavet til specielle AI-job.

Du får hurtige svar og sparer energi.

Tip: Når du vælger en AI-accelerator, så tænk over dine AI-opgaver og hvor meget du skal ændre tingene. Hver type er god til forskellige opgaver.

Optimering af AI-arbejdsbelastning

Træning vs. inferens

Der er to hovedtrin i kunstig intelligens. Det første er træning. Træning kræver en masse computerkraft. Du løser mange matematiske problemer igen og igen. Stærke kunstig intelligens-acceleratorer hjælper med disse vanskelige opgaver. Det andet trin er inferens. Inferens betyder, at kunstig intelligens ser på nye data og træffer valg. Dette trin kræver ikke så meget hardware. Du kan bruge én accelerator eller endda en CPU.

Bemærk: At gøre inferens hurtigere kan spare mange penge. Mange AI-værktøjer, såsom svindeltjek og forslag, kræver hurtig og intelligent inferens.

Den hardware, du vælger, afhænger af dit job. Her er nogle eksempler:

Scenario | Træningsudstyr | Inferenshardware |

|---|---|---|

Salgsprognosemotor | CPU | CPU |

Billedklassificeringsmodel | GPU | CPU eller GPU om nødvendigt |

Måden du udfører inferens på, kan variere. Det afhænger af, hvor stor din model er, hvor du bruger den, og hvor hurtigt du vil have svar. Du skal muligvis sætte ting op, finjustere dem, sætte dem på plads, arbejde med store modeller eller bruge dem i udkanten af systemet. At lave et godt inferenssystem kræver ofte eksperter. Det handler ikke kun om ny hardware.

Parallelle beregningsteknikker

Du kan få AI til at fungere bedre ved at bruge parallel beregning. Det betyder, at du opdeler store job i små. Du kører disse små job på samme tid. AI-acceleratorer bruger forskellige måder at gøre dette på:

Parallel processering opdeler job på tværs af mange CPU'er eller GPU'er. Dette gør, at AI arbejder hurtigere og bedre.

Dataparallelisme opdeler dine data i mindre stykker. Hver accelerator arbejder på ét stykke. Du sætter alle svarene sammen.

Modelparallelisme opdeler AI-modellen. Forskellige acceleratorer arbejder på forskellige dele på én gang.

Disse metoder hjælper AI-apps med at arbejde hurtigere. For eksempel bruger GPU'er og NPU'er parallel processering til at understøtte deep learning og spare energi. Du får bedre resultater og kan arbejde med større AI-opgaver uden at sætte farten ned.

Sammenligning af acceleratorer

Ydeevne og effektivitet

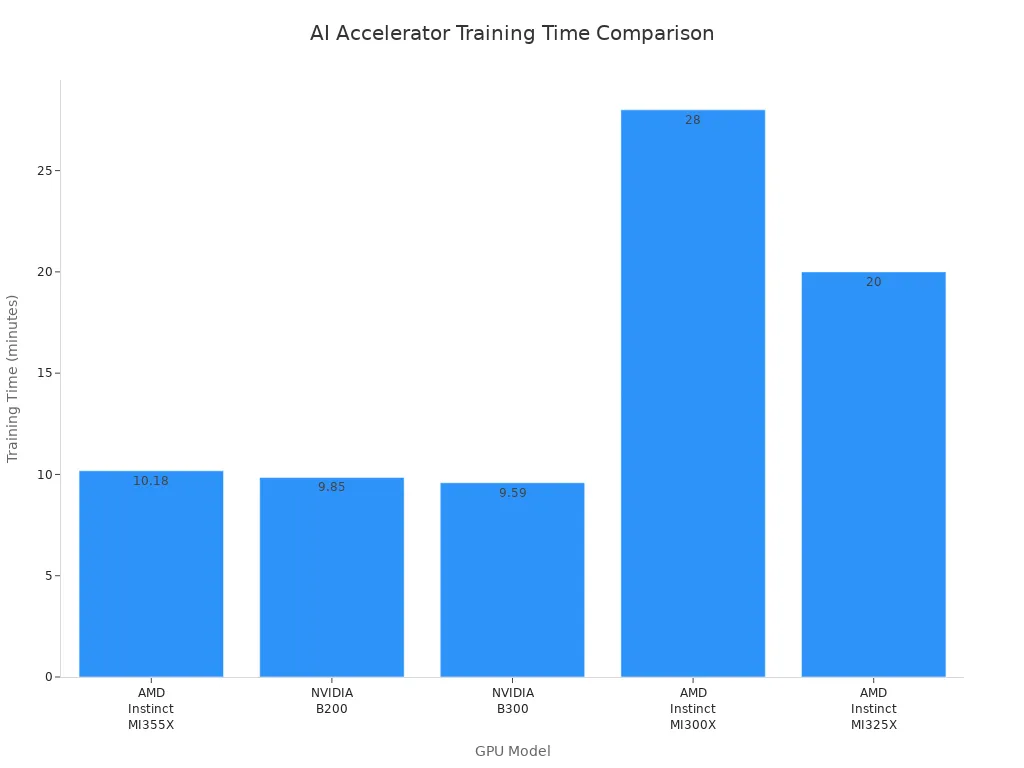

Du vil have din AI-projekter skal køre hurtigt og bruger mindre energi. Når du sammenligner forskelligt hardware, ser du på, hvor hurtigt de afslutter opgaver, og hvor meget strøm de bruger. Nogle acceleratorer kan træne AI-modeller meget hurtigere end andre. For eksempel viser de seneste benchmarkresultater, at NVIDIA B300 kan afslutte træningen på bare 9.59 minutter. AMD Instinct MI355X er op til 2.8 gange hurtigere end ældre modeller. Du kan se, hvordan disse enheder klarer sig i tabellen nedenfor.

GPU Model | Træningstid (minutter) | Præstationsforøgelse |

|---|---|---|

AMD Instinct MI355X | 10.18 | Op til 2.8 gange hurtigere |

NVIDIA B200 | 9.85 | N / A |

NVIDIA B300 | 9.59 | N / A |

AMD Instinct MI300X | 28 | N / A |

AMD Instinct MI325X | ~ 20 | N / A |

Du kan bruge disse tal til at vælge den bedste AI-hardware til dine behov. Hurtigere træning betyder, at du kan afprøve flere idéer og få resultater hurtigere. Høj ydeevne hjælper dig også med at spare energi og penge. Når du vælger den rigtige hardware, øger du både hastighed og effektivitet.

Implementeringsscenarier

Du kan bruge kunstig intelligens mange steder, f.eks. i skyen eller i edge-netværket. Hvert sted har sine egne fordele og begrænsninger. Hvis du kører kunstig intelligens i edge-netværket, reducerer du netværksforsinkelser. Du holder også dine data private og sænker omkostningerne. For eksempel kan kunstig intelligens i edge-netværket fjerne 50 til 200 millisekunders ventetid på netværket. Det reducerer også dataomkostningerne med op til 80 %. I skyen kan du opleve højere forsinkelser og mere dataforbrug.

Her er en tabel, der kan hjælpe dig med at sammenligne edge- og cloud-AI:

Aspect | Fordele ved Edge AI | Cloud AI-begrænsninger |

|---|---|---|

Latency | Eliminerer netværksforsinkelse på 50-200 ms | Høj latenstid på grund af dataoverførsel |

Datasikkerhed | Behandler følsomme data lokalt | Kræver dataoverførsel til eksterne servere |

Båndbreddeoptimering | Reducerer båndbredde ved at behandle data lokalt | Høj båndbreddeforbrug til dataoverførsel |

Omkostningsreduktion | 60-80% reduktion i omkostninger til dataoverførsel | Højere driftsomkostninger på grund af båndbredde |

Du bør overveje, hvor du vil have din AI til at køre. Hvis du har brug for hurtige svar og privatliv, fungerer Edge AI bedst. Hvis du har brug for masser af kraft til store opgaver, kan cloud-AI være bedre. Det rigtige valg afhænger af dit projekt og dine mål.

Udfordringer og tendenser

Integrationsproblemer

Når du bruger hardwareacceleratorer i AI, kan du støde på problemer. Du skal sørge for, at din hardware og software fungerer godt sammen. Hvis de ikke stemmer overens, kan dine AI-modeller køre langsomt. Du skal også være opmærksom på, hvor meget energi og hukommelse du bruger. Dette er meget vigtigt med store AI-modeller. Nogle gange er du nødt til at ændre din opsætning for nye AI-metoder. Tabellen nedenfor viser nogle almindelige problemer:

Udfordring | Beskrivelse |

|---|---|

Få den bedste hastighed ved at matche hardware og software. | |

Ressourceeffektivitet | Bruger mindre energi og hukommelse til store AI-modeller. |

Tilpasningsevne | Sørg for, at dit system kan tilpasses nye AI-idéer. |

Du kan bruge ny software til at løse disse problemer. For eksempel giver SNAX dig mulighed for nemt at forbinde forskellige acceleratorer. Det giver dig et simpelt lag, så du kan fokusere på dit AI-arbejde. SNAX-MLIR hjælper dig med at bruge hukommelse og data bedre. Dette får dit AI-system til at arbejde hurtigere.

Tip: Værktøjer som SNAX giver dig mulighed for at tilføje nye acceleratorer og ændre din opsætning, efterhånden som din AI vokser.

Fremtiden for AI-hardware

Store forandringer er på vej for AI-hardware. Virksomheder laver nu specielle AI-chips til bestemte opgaver. Disse chips hjælper din AI med at køre hurtigere og bruge mindre energi. Du vil også se flere systemer, der bruger forskellige processorer sammen, såsom GPU'er, FPGA'er og ASIC'er. Dette kaldes heterogen computing. Det hjælper dig med at få de bedste resultater for hvert AI-job.

Her er nogle tendenser for fremtiden:

Brugerdefinerede AI-chips som NPU'er og TPU'er bruges mere.

Edge computing giver dig mulighed for at behandle data tæt på, hvor du modtager dem. Dette reducerer forsinkelser og holder dine data private.

Neuromorfisk databehandling bruger hjernelignende designs til at spare energi og forbedre kunstig intelligens.

Kvanteberegninger kan løse meget vanskelige problemer, men der er stadig mange problemer, der skal løses.

Eksperter mener, at markedet for AI-hardware vil vokse meget. I 2024 er markedet på 16.55 milliarder dollars. I 2029 kan det være på 52.76 milliarder dollars. Det betyder, at det vokser med omkring 26 % hvert år.

Bemærk: Efterhånden som AI-hardware bliver bedre, vil du have flere måder at gøre dine AI-projekter hurtigere og stærkere.

Du får mange gode ting ud af hardwareacceleratorer i AI. Disse værktøjer hjælper dig med at arbejde hurtigere. De giver dig mulighed for at træffe valg med det samme. Du sparer også penge, når du bruger dem. Se tabellen nedenfor for et hurtigt overblik:

Fordel | Beskrivelse |

|---|---|

Forbedret ydeevne | Gør AI hurtigere og fungerer bedre |

Energieffektivitet | Bruger mindre strøm til AI-job |

Skalerbarhed | Kan vokse i takt med at din AI bliver større |

Vælg den bedste accelerator til dit AI-job. Nye chipdesigns og måder at spare energi på vil ændre, hvordan AI fungerer i fremtiden.

Ofte stillede spørgsmål

Hvad er en hardwareaccelerator i AI?

En hardwareaccelerator er en speciel chip eller enhed. Du bruger den til at gøre AI-opgaver hurtigere. Den hjælper din computer med at håndtere big data og komplekse modeller uden at blive langsommere.

Hvorfor har du brug for forskellige typer AI-acceleratorer?

Du har brug for forskellige acceleratorer, fordi hvert AI-job er unikt. Nogle fungerer bedst til træning, andre til hurtige svar. Du vælger den rigtige for at få den bedste hastighed og spare energi.

Kan man bruge hardwareacceleratorer derhjemme?

Ja, du kan bruge nogle acceleratorer derhjemme. Mange bærbare og stationære computere har GPU'er. Disse hjælper dig med at køre AI-programmer til læring, spil eller små projekter.

Hvordan sparer hardwareacceleratorer energi?

Hardwareacceleratorer afslutter AI-opgaver hurtigt. De bruger mindre strøm end almindelige CPU'er. Dette hjælper dig med at spare energi og sænke din elregning.

Hvad er fremtiden for AI-hardware?

Du vil se flere brugerdefinerede chips til AI. Disse vil gøre dine enheder smartere og hurtigere. Nye designs som neuromorfe og kvantechips vil ændre, hvordan du bruger AI.